C’è una differenza profonda tra un problema reale e la storia che raccontiamo su quel problema.

Il cambiamento climatico è reale. Le disuguaglianze sono reali. Le trasformazioni tecnologiche sono reali. Le tensioni identitarie sono reali. Ma tra la realtà e il racconto pubblico si apre uno spazio in cui accade qualcosa di decisivo: i fatti vengono sostituito dalla narrazione.

Una narrazione non è, di per sé, un male. È una forma inevitabile di semplificazione. Diventa tossica quando smette di essere uno strumento per capire e diventa uno strumento per appartenere. Quando non serve più a cercare la verità, ma a segnalare identità. Quando trasforma problemi complessi in drammi morali con personaggi fissi: vittime permanenti, colpevoli permanenti, salvatori permanenti. Il punto non è stabilire quali temi siano “giusti” o “sbagliati”. Il punto è capire quando il modo in cui li trattiamo smette di essere scientifico — e diventa ideologico.

Il metodo come linea di demarcazione

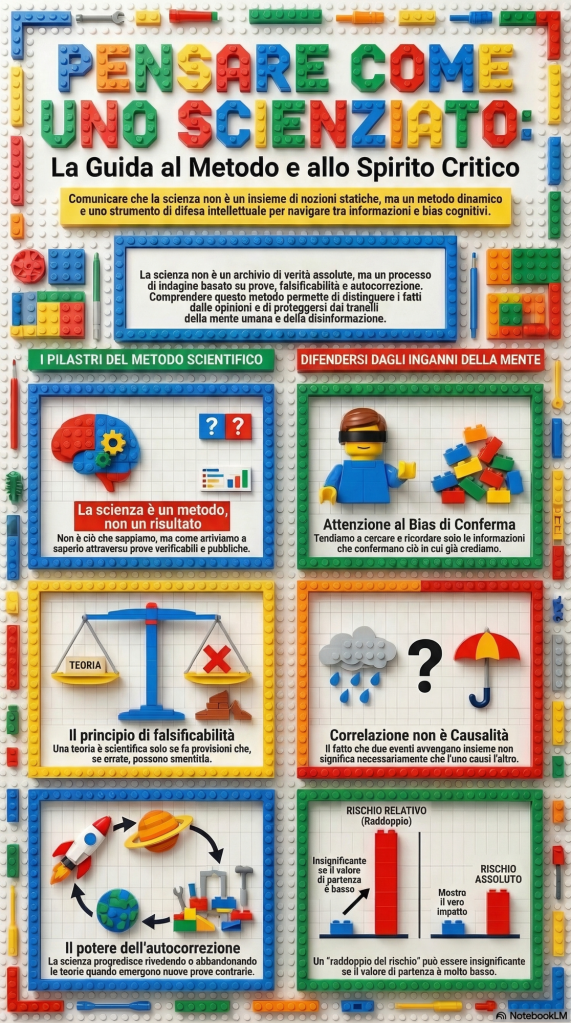

La scienza non è un insieme di risposte definitive. È un metodo: basato su prove, falsificabilità, autocorrezione e gestione esplicita dell’incertezza . Questo metodo non garantisce infallibilità. Garantisce qualcosa di più prezioso: la possibilità di correggersi.

Le narrazioni tossiche condividono una caratteristica comune: non si lasciano correggere. Sono impermeabili alla smentita. Ogni fatto contrario viene riassorbito come conferma. Ogni dubbio viene interpretato come ostilità morale. È qui che il metodo si interrompe.

Clima: tra apocalisse e negazione

Il cambiamento climatico è un fatto fisico robustamente documentato. Ma attorno a questo fatto si sono costruite due narrazioni speculari e tossiche.

La prima è apocalittica: “Siamo già oltre il punto di non ritorno, chi discute costi e alternative è complice del disastro.” La seconda è identitaria: “È un’esagerazione costruita per controllare l’economia.”

Entrambe tradiscono il metodo. La prima confonde diagnosi e terapia: la scienza può stabilire che esiste un problema; non può decretare quale politica sia moralmente obbligatoria senza analisi dei trade-off. La seconda ignora il principio basilare secondo cui una teoria deve essere falsificabile: negare sistematicamente l’evidenza accumulata non è scetticismo, è rifiuto della prova.

La postura scientifica è più esigente. Chiede: quali politiche riducono le emissioni in modo misurabile? Con quali costi? Con quali effetti distributivi? Con quali incentivi? Non cerca purezza morale, ma efficacia empirica.

Disuguaglianza: tra struttura onnipotente e responsabilità nulla

La disuguaglianza è un tema legittimo e complesso. Ma anche qui la narrazione tende a polarizzarsi.

Da un lato: “Ogni differenza è il prodotto di un sistema oppressivo.” Dall’altro: “Ogni differenza è il risultato di scelte individuali.”

Entrambe le versioni falliscono sul piano metodologico. La prima spesso confonde correlazione e causalità, ignora variabili confondenti e trasforma categorie sociali in essenze morali. La seconda cancella il ruolo dei contesti, delle reti, degli shock, dell’accesso alle opportunità.

Il metodo impone domande più precise: disuguaglianza di cosa? Reddito, ricchezza, consumi? In quale arco temporale? In quali coorti? Con quali strumenti di misura? È un problema di mediana o di coda della distribuzione?

La realtà sociale è quasi sempre probabilistica e contributoria, non deterministica. Le cause non sono necessarie né sufficienti: aumentano probabilità. Chi pretende spiegazioni totali sta già tradendo la complessità.

Genere e identità: quando la categoria diventa destino

Le discriminazioni esistono. Negarlo sarebbe antiscientifico. Ma altrettanto antiscientifico è trasformare ogni esito differente in prova automatica di oppressione.

Quando una teoria spiega qualsiasi risultato possibile, smette di essere informativa. Se qualunque differenza conferma l’ipotesi, non esiste più un criterio di smentita. È la violazione più grave del principio di falsificabilità. A questo si aggiunge il bias di conferma, amplificato dagli algoritmi . In una filter bubble, ogni informazione sembra confermare ciò che già crediamo. La narrativa si autoalimenta. Il dissenso viene interpretato come aggressione morale.

Il metodo impone un esercizio più difficile: cercare attivamente prove contrarie. Chiedersi quali dati mi farebbero cambiare idea. Distinguere tra gap grezzi e gap aggiustati. Non ridurre l’individuo alla categoria.

AI e lavoro: il fascino del determinismo

L’intelligenza artificiale è forse il terreno più fertile per le narrazioni estreme.

Da un lato: “Scompariranno quasi tutti i lavori.” Dall’altro: “La tecnologia risolve sempre tutto.”

Entrambe le affermazioni sono premature. La storia economica mostra distruzione e creazione simultanea di compiti, adattamenti istituzionali, trasformazioni graduali. L’AI non è una forza naturale inevitabile: i suoi effetti dipendono da politiche, regole, incentivi, distribuzione del potere.

In più, i Large Language Models producono testo plausibile anche quando non dispongono di informazioni corrette . La fluenza non è prova. La sicurezza retorica non è evidenza. Il metodo chiede dati longitudinali, replicazioni, analisi di impatto. Non profezie.

Stato e protezione: tra salvezza totale e rifiuto totale

Anche il dibattito sul ruolo dello Stato oscilla tra due eccessi.

“La politica deve proteggere tutti da ogni rischio.” “Ogni intervento pubblico genera dipendenza e distorsione.”

Entrambe le posizioni ignorano gli incentivi . Ignorano che le politiche producono effetti comportamentali. Ignorano che le risorse sono finite. Ignorano che la significatività statistica non equivale alla rilevanza pratica .

La domanda scientifica non è “Stato sì o no”. È: quale strumento? Con quale disegno? Con quale valutazione controfattuale? Con quali effetti misurabili?

Declinismo e ottimismo cieco

Viviamo anche sotto due narrazioni opposte sullo stato del mondo.

Una è declinista: “È tutto peggio di prima.” L’altra è ingenuamente progressista: “I dati mostrano miglioramenti, quindi i problemi attuali sono esagerati.”

Entrambe soffrono dell’euristica della disponibilità e della selezione opportunistica degli indicatori. Il metodo richiede di guardare serie storiche, distribuzioni, comparazioni internazionali. E di accettare l’incertezza. Accettare l’incertezza non è debolezza. È maturità epistemica.

La tossicità come rifiuto della revisione

Una narrazione diventa tossica quando:

– non è falsificabile;

– moralizza il dissenso;

– ignora variabili confondenti;

– confonde rischio relativo e assoluto ;

– seleziona solo le prove favorevoli;

– si diffonde per engagement, non per robustezza empirica;

– non si aggiorna alla luce di nuove evidenze.

La scienza è fragile, ma è fragile in modo virtuoso: si espone alla smentita. Le narrazioni tossiche sono robuste in modo vizioso: non si lasciano toccare dai fatti.

Una competenza civica, non accademica

Il punto finale è questo: il pensiero scientifico non è un lusso per ricercatori. È una competenza civica . In una democrazia, la qualità delle decisioni collettive dipende dalla capacità di distinguere prove da opinioni, correlazione da causalità, significatività da rilevanza, rischio relativo da rischio assoluto.

Non serve sostituire una narrazione con un’altra. Serve sostituire la certezza tribale con la domanda esigente. Non: “Chi ha ragione?” Ma: “Quali sono le prove? Quanto sono forti? Quali alternative sono state escluse? Quali incentivi sono in gioco? Cosa mi farebbe cambiare idea?”

Pensare come uno scienziato non elimina il conflitto. Ma lo disciplina. E in un’epoca in cui le convinzioni si diffondono più velocemente delle verifiche, questa disciplina è una forma di libertà. Ed è, forse, l’unica vera alternativa alle narrazioni tossiche del nostro tempo.